※更新:2026.4.29 :NVFP4がvLLMで実用レベルに到達

Swallow / Qwen 3.5 / Nemotron 3 を使い分けるVRAM設計術

【2026年4月追補】 ※Swallow系についてはNVFP4モデルが未公開のため、現時点ではMXFP4(llama.cpp構成)が実用解となります。

【導入】1200億パラメータの知能を、ローカルで運用する。 外部のネットワークに依存せず、自身の管理下で「知能」を動作させる。

NVIDIA Blackwell (GB10) 128GB を搭載したDGX Spark互換機が手元に届いてから数ヶ月。取り組んできたのは、巨大な情報の壁をローカルAIで解体し、構造化された知見へと変換するプロセスの構築です。

一般に、70Bクラスのモデルを一切の妥協(量子化)を排したFP16精度で運用するには140GB以上のVRAMが必要であり、128GBという広大な環境をもってしても、これまでは32Bクラスが実務上の物理的な一つの限界でした。確かに30B級モデルは実用的な速度で動きますが、医療や政策といった「行間のニュアンス」に重要な意味が隠されているドメインにおいては、30Bは時として要約という名の「情報の切り捨て」を行ってしまう懸念がありました。

今回、Blackwellの広大なVRAM容量とNative FP4演算を活かすことで、ついに120B級という選択肢が、現実的な運用コスト(速度・安定性)の範囲内に収まってきたと感じています。

※本構成は特定条件下での検証結果であり、すべての環境で同様の結果を保証するものではありません。

English Summary: Note: This article does not claim that NVFP4 support on NVIDIA Blackwell GB10-class systems is fully solved. It documents a practical, condition-dependent setup where 120B-class NVFP4 inference became usable, while MXFP4 with llama.cpp remains an important fallback path for evaluating and operating local LLMs.

実務観点:

本記事で検証する「ローカル推論の到達点」

30Bから120Bへの移行による変化 :FP16運用の目安であった30Bクラスを超え、なぜ「1200億」が実務における読解の「納得感」に繋がるのかを考察します。実測46.4 tokens/sのスループット :120B級モデルをBlackwellはどのように淀みない速度で処理するのか。その実行ログを記録しました。安定稼働を支えるVRAMリソース設計 :128GBメモリをKVキャッシュや推論バッファにどう配分し、長尺データを滞りなく処理し切るか。設計思想を公開します。

検証の題材として、2013年に日本記者クラブで行われた、社会保障制度改革国民会議 の清家会長による「報告書」の解説会見(約1時間)を選定しました。最新知能が数分で重厚な議論を解体・構造化していく様子を、技術データと共にレポートします。

【第1章】エンジン選定とビルドの記録:vLLMからllama.cppへの回帰 推論環境の構築において、最初に直面した課題は「推論エンジンの選択」でした。当初はスループットに定評のあるvLLM等での運用を検討していましたが、検証を重ねる中で最終的にllama.cppによるソースビルドへと回帰する決断を下しました。

vLLM における「V1エンジンの壁」とドライバの不整合

【補足(2026年4月時点)】 ※ 本構成は2026年3月時点の llama.cpp / MXFP4 検証結果です。※ 2026年4月時点では、vLLMによるNVFP4構成も検証を進めており、本章末尾に追記しています。

最新(記事執筆時点)のvLLMは強力なバックエンドを有していますが、Blackwell環境下での運用において、特定の条件下で推論エンジンが旧式の「V1」へフォールバックする挙動が確認されました。これは580系ドライバ環境下でのバリデーション・チェックの厳格化により、JIT(実行時コンパイル)が失敗するケースがあるためと考えられます。

【補足】vLLM V1 と新世代実行系の違い

Ollamaにおける「分割GGUF」の認識問題 120B級モデルはファイルサイズが 100GBを超えるため、複数のGGUFファイルに分割されるのが一般的です。検証段階では、当時のOllamaにおいて2枚目以降の分割ファイルを正しく認識・ロードできない現象が発生しました。結果として、巨大な知能を起動させるには(記事執筆時点のバージョンでは)分割モデルの読み込みに難があり、採用を断念しました。

llama.cppソースビルドによる「Blackwell / Grace への最適化」 こうした外部ラッパーの不安定さを排除し、ハードウェアの力を直接制御するため、llama.cppをソースからビルドする道を選びました。DCMAKE_CUDA_ARCHITECTURES=121を明示し、第5世代Tensor CoreやFP4演算命令をターゲットとしたネイティブ・バイナリを生成することで、長尺リクエストに対しても安定して動作する推論基盤が確立されました。

【Expert Insight】エンタープライズ運用における NIM という選択肢

NVFP4実動構成(vLLMによる120B運用レシピ)

※補足: SGLang は、効率的なキャッシュ活用や連続バッチ処理により高いバッチ性能が期待される推論エンジンですが、本検証環境のDGX Spark互換機上で大規模Qwen系モデルのバッチ処理を確認した範囲では、vLLMを置き換えるほどの実効スループット改善は確認できませんでした。

環境やワークロードによってはSGLangが優位となるケースも考えられますが、現時点では継続的なバッチ処理用途においてvLLM構成を採用しています。

■ モデル構成サマリー

モデル

配布元

役割

コンテキスト

並列

備考

Qwen3.5-122B

RedHatAI / Sehyo / txn545 並列処理

256k

4

出力制御

Nemotron3-120B

RedHatAI / Unsloth 高精度推論

1M

1

思考ログ制御

本構成は、VRAM制約下で120B級モデルを実用運用するために、精度・並列性・コンテキスト長(VRAM消費)を用途別に切り分けて制御した設計です。

■ 推論パラメータ設計

項目

設定値

意図

dtype

bfloat16

精度・安定性確保

kv-cache-dtype

fp8

KV圧縮(長コンテキスト確保)

gpu-memory-utilization

0.91

VRAM最大活用(OOM回避)

max-model-len

256k(実運用) / 1M(実運用・条件付き)

用途別運用(精度/長文の切替)

max-num-seqs

Qwen3.5:4 / Nemotron3:1

過負荷防止

prefix-caching

有効

定型プロンプト再利用

■ 実測性能(初回リクエスト・参考値) ※ 本表は短文・単発リクエストの挙動確認であり、第7章の長文処理性能とは条件が異なります。

モデル

配布元

条件

Prefill

Generate

出力傾向

Qwen3.5-122B

RedHatAI

256k / 1seq

5.4

16.6〜16.7

トークナイザ差替

Sehyo

256k / 1seq

5.4

16.7〜16.8

トークナイザ差替

txn545

256k / 1seq

5.4

14.6〜14.7

トークナイザ差替

Nemotron3-120B

RedHatAI

1M / 1seq

7.2

15.0〜15.1

chat-template制御

Unsloth

1M / 1seq

7.2

14.9〜15.0

chat-template制御

※ 本表は、各コンテナ起動後の初回リクエストを1シーケンス・temperature 0で実行した短文プロンプトの参考値です。主にGenerate速度とthinkタグ表出の有無を確認するためのものであり、長文入力時のPrefill性能については、別途、約1.8万文字の文字起こしデータで確認します。※ 測定は単一リクエスト・短文条件での参考値であり、環境・負荷・出力長により変動します。

【Qwen3.5-122B・リクエスト】を見る

docker exec -it vllm-qwen35-122b-nvfp4 curl http://localhost:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "qwen35-122b-nvfp4",

"messages": [

{"role": "user", "content": "日本のDPC(診断群分類別包括評価方式)制度における「効率性係数」と「複雑性係数」の役割の違いを、病院経営の視点から簡潔に説明してください。"}

],

"temperature": 0

}'

【Nemotron3-120B・リクエスト】を見る

docker exec -it vllm-nemotron3-120b-nvfp4 curl http://localhost:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "nemotron3-120b-nvfp4",

"messages": [

{"role": "user", "content": "日本のDPC(診断群分類別包括評価方式)制度における「効率性係数」と「複雑性係数」の役割の違いを、病院経営の視点から簡潔に説明してください。"}

],

"temperature": 0

}'

【RedHatAI Qwen3.5-122B・レスポンス抜粋】を見る

Prompt tokens: 54 / Completion tokens: 630

Prefix cache hit rate: 0.0%

thinkタグ表出なし

【Sehyo Qwen3.5-122B・レスポンス抜粋】を見る

Prompt tokens: 54 / Completion tokens: 579

Prefix cache hit rate: 0.0%

thinkタグ表出なし

【txn545 Qwen3.5-122B・レスポンス抜粋】を見る

Prompt tokens: 54 / Completion tokens: 665

Prefix cache hit rate: 0.0%

thinkタグ表出なし

【RedHatAI Nemotron3-120B・レスポンス抜粋】を見る

Prompt tokens: 72 / Completion tokens: 681

Prefix cache hit rate: 0.0%

冒頭に</think>表出(内部思考の閉じタグのみ残存)

【Unsloth Nemotron3-120B・レスポンス抜粋】を見る

Prompt tokens: 72 / Completion tokens: 1210

Prefix cache hit rate: 0.0%

冒頭に</think>表出(内部思考の閉じタグのみ残存)

【第2章】検証対象:3つの120B級巨大モデルの特性と設計 実機デモに進む前に、今回 Blackwell上で稼働させた3つのモデルの特性と、それぞれのスロット設計について整理します。

Swallow-120Bにおける 32,768 設定の意図 :

【第3章】推論スループットの実測:Blackwell GB10 検証結果 Blackwellの推論性能を客観的に評価するため、約1.8万文字(1時間強の音声文字起こしデータ)の構造化タスクを各モデルに実行させました。ここでは、推論エンジンから出力された実測値と、ハードウェア・リソースの稼働状況を技術的な視点から記録します

技術注記:KVキャッシュ(作業メモリ)の最適化 FP16 (16bit): 文脈の「行間」を読み解く精度を最優先し、32k〜256kの範囲で運用 (Swallow/Qwen)。Q8_0 (8bit): 100万トークンの長大な情報をVRAMに収めるため、メモリ効率を最優先して運用 (Nemotron)。

モデル別実機デモ

日本語処理の応答性能 (MXFP4 / KV: FP16) 【GPT-OSS-Swallow-120B-RL-v0.1-MXFP4_MOE】

VIDEO

Prefill (論理読込速度) 1,976.0 t/s

Generation (応答生成速度) 46.4 t/s

技術的評価: 日本語の継続事前学習による高い指示遵守を維持しつつ、120B級では異例の応答性能。13,214トークンの入力をわずか6.7秒で処理し、実務上の「待ち時間」を解消しています。

論理推論の精度と安定性 (MXFP4 / KV: FP16) 【Qwen3.5-122B-A10B-MXFP4_MOE】

VIDEO

Prefill (論理読込速度) 926.3 t/s

Generation (応答生成速度) 21.8 t/s

技術的評価: 実務上の出力品質を維持したまま、ハルシネーションを抑えた安定した論理構築が確認されました。8,254トークンの入力を8.9秒で処理。120B級モデルとして実用域にあるスループットと論理整合性を示しています。

長尺コンテキストの保持能力 (MXFP4 / KV: Q8_0) 【NVIDIA-Nemotron-3-Super-120B-A12B-MXFP4_MOE】

VIDEO

Prefill (論理読込速度) 644.5 t/s

Generation (応答生成速度) 16.4 t/s

技術的評価: 将来的な100万トークン級の処理を見据えた広大な思考領域を確保しつつ、今回は約1.2万トークンの入力を安定して処理。VRAMリソースを「情報の網羅性と保持力」に振り向けた、長尺分析特化型のポテンシャルを示しています。

実戦タスク:TextGenerator用テンプレート 今回のスループット計測では、単なる要約(Summary)ではなく、プロフェッショナルの分析業務に比肩する「論理解体(Logical Deconstruction)」 を検証タスクとして設定しました。120B級モデルが持つ圧倒的な「文脈の保持能力」を限界まで引き出すべく、高度な論理構造解析に特化して設計した専用テンプレート を投入します。

補足:{{input}}変数と「知能」の安定性について

テンプレート内の{{input}}には、約1.8万文字(1時間強の会見) の文字起こし全文が動的に注入されます。30B級モデルでもコンテキスト窓のスペック上は収容可能ですが、この規模の入力を論理的に解読しようとすると、中盤以降で推論の「粘り」が失われ、提言が定型文化したり主述を混同するケースが散見されます。Blackwell上の128GBリソースは、120B級の知能密度 を維持したまま、この巨大なプロンプトを最後まで精密に処理するための揺るぎない土台となります。

クリックしてテンプレートを展開(TextGenerator用プロンプト)

# [SYSTEM_COMMAND: DATA_TRANSFORMER_LOGIC]

あなたは感情や知識を排し、入力テキストを「主辞(誰が)」と「述辞(何を)」に分解する専用プログラムです。

以下のルールに従い、入力から事実のみを日本語の構造化データへ変換せよ。

# [STRICT_PARSING_RULES: 絶対解析ルール]

1. **論理エンティティの分離(主語の固定)**:

- 「発話者(声を出している本人)」と「言及主体(話題にのぼっている人物・組織・技術)」を別人格として識別せよ。

- **重要:発話者が第三者について語っている場合、主体を混同せず、必ず区別して記述せよ。**

2. **情報の不純物排除(NO_EXTERNAL_KNOWLEDGE)**:

- 入力データに存在しない西暦(年)、組織名、特許番号、出典、メタデータを自発的に補完することを「データ改ざん」とみなし、厳禁とする。

- 年の記載がない日付は、月日のみを記せ。

3. **挨拶・前置きの物理的禁止**:

- 「以下は~」「要約しました」等の人間的な文章を1文字も許容しない。

- 1文字目から「# 【分析レポート:」の見出しを開始せよ。

4. **構造化の強制(3列テーブル)**:

- 「事実関係の構造化分析」セクションは、必ず以下の形式で出力せよ。

| 分類:主語(誰が) | 内容(何を) | 論理的補足(状況) |

# [OUTPUT_STRUCTURE: 指定構成]

1. **エグゼクティブサマリー**: 事実のみを3行以内で。

2. **事実関係の構造化分析**: 3列テーブル(発話者と主体を明確に分離)。

3. **潜在的リスクおよび機会**: データに基づく客観的抽出。

4. **提言**: 具体的な次の一手。

---

# [Input Data]

{{input}}

---

# [Execution Trigger]

前置き不要。日本語のみ。1文字目から「# 【分析レポート:」を開始し、3列の表を含めよ。

# 【分析レポート:

※ 120B級モデルが持つ「高い論理保持能力」を最大限に引き出すため、あえて人間的な情緒を排した命令体系を採用しています。

【実務上の留意点:知能の現在地と今後の課題】

本検証の主眼は、120B級の巨大な知能を128GBのVRAM内で安定稼働させるための「器(インフラ)」の設計図を確立すること にあります。実機検証の結果、数万トークンに及ぶ長尺コンテキストにおいては、MXFP4量子化の特性や推論エンジンの最適化状況に起因すると推測される「論理の一貫性の低下」や「指示遵守のゆらぎ(中だるみ)」が一部で確認されています。

しかし、この「巨大な知能を外部に依存しない独立した管理環境で駆動させる土俵」 を構築できたという事実こそが、機微情報を扱うドメインにおけるローカルAI運用の、新たな実務のスタートラインとなります。知能の精度(質)については、今後のモデル更新や量子化技術の進展を待つことで、この堅牢なインフラの上でさらに開花していくものと考えています。

検証に使用したソースデータ

【入力データ】Whisper連携フローによる一次テキスト

解析対象:約1.8万文字 約8,200〜13,300tokens (モデル別のTokenizerに依存)

本検証では、第 2 弾記事「vLLM と Whisper の共存レシピ」 で構築したパイプラインの中間処理として生成される「一次テキストデータ」 を解析対象とします。前回は32Bモデルでの要約生成までを実演しましたが、今回はその出力を120B級の知能へと受け渡し、Blackwellのリソースを使い切るための「高負荷ベンチマーク」として採用しました。

クリックして解析対象の全文を表示(Whisper文字起こし全文)

お待たせしました。時間となりました。連日の申し上げの中、ご参加いただきまして、今日はどうもありがとうございます。今日は日本の将来を大きく左右します社会保障と税の一体改革、このうちの社会保障の処方箋、どう維持するかという処方箋にあたる報告書を先日まとめました社会保障制度改革国民会議の議長で、慶応義塾塾長の清家敦史さんにおいでいただきました今回の報告書についてはもう皆さんご承知の通りいろんな見方がありますけれども大型の人たちがこれは避けられないと思っているのが給付も負担も全世代多様型にするというものですけれども今後どうしても我々が扱うニュースの世界で焦点になるのはやはり負担増の話だと思います。医療でも介護でもこれから負担増の話が目白押しにやってきます。この時に本来の考え方である前世代対応型という考え方がどれだけ維持できるのかと、どれだけきちっと踏まえることができるのかということが焦点になってくるだろうと思います。そのためにも今日は今回の報告書、なぜこういうことになったのか、何が重要なのかという点をぜひ正規さんにご解説、ご説明をいただきまして、ご講演いただきまして、その後皆さんたくさんご質問されたい方いらっしゃると思いますので、その後質疑応答に移りたいと思います。申し遅れましたが、司会を担当いたしますのは日本記者クラブの企画委員をしておりますNHK解説委員の武田です。それでは関さんどうぞよろしくお願いします。はい、ありがとうございます。石井さんどうぞよろしくお願いしますはいありがとうございますただいまご紹介いただきました社会保障制度改革国民会議の会長をしております慶応義塾大学の政家でございます本日は社会保障制度改革国民会議の報告書について皆様方にご説明をする機会をお与えいただきまして大変ありがとうございますとても景色のいい場所でお話をさせていただくことをありがたく思っています。まず、社会保障制度改革国民会議を代表して、少し報告書の内容をご説明申し上げ、その後、質疑、皆様方からのご質問にお答えしていきたいというふうに思っております。まず、もうすまでもないわけでございますけれども、日本は今、世界に類を見ない高齢化を経験しつつあるわけでございます。すでに総人口の25%、すなわち4分の1が65歳以上の高齢者になろうとしておりましてこれに伴ってですね年金医療介護といったようなものを中心とする社会保障給付は年間で100兆円を超える多分直近ではもう110兆円ぐらいになっているかと思いますがそうした規模となっておりますこの社会保障給付のおそらく6割ぐらいは社会保険料で支えられているかと思いますが残りはいわゆる税財源による公費によって賄われているわけでございますそしてその公費税財源と言いましてもご承知の通り今税収は税財源を全て賄うことございませんのでそのかなりの部分がいわゆる国債などによって賄われるという形で将来世代に付け回されているということでございますその結果ご承知の通り最近の報道等によりますと、国の借金の総額が1000兆円のお題を超えるというレベルになっているわけでございます。つまり今申し上げた論理で言えば、人口の高齢化というのが社会保障給付の急増をもたらして、そしてその社会保障給付の急増が財政の危機的な状況を生み出している根本的な原因である日本の人口の高齢化というのは言うまでもないことですけれども、その一つの理由は日本人が世界で最も長寿の国民になったということの結果でもあるわけでありますそして日本人が世界で最も男女とも長寿になり得たのはどうしてかといえば当然ですけれども医療や介護の給付が充実することによって寿命が延びまた年金の給付が行き渡ることによって長い老後人生を送ることができるようになったということによって、日本が世界に類を見ない長寿化、高齢化によって社会保障制度の今見直しが必要となっているわけですが実はその長寿化あるいはその結果としての高齢化は社会保障制度の充実によって医療や介護の給付が行き渡るようになりあるいは年金の給付が行き渡るようになった結果でもあるとつまり現在の社会保障制度が抱える問題というのは社会保障制度の成功の結果として生まれたと発生したというふうにも言えるわけでありまして私たちはその意味では日本を世界に勘たる長寿国にした社会保障制度をしっかりと将来世代に伝えていかなければいけないというふうに考えておりますそのために実は消費税といった税財源であるとか、あるいは負担能力のある人には高齢者も含めて年齢に関わりなく一定の負担�世代型の社会保障制度が必要になるというふうに考えたわけでございます私ども社会保障制度改革国民会議15名の委員から構成されておりますけれどもこの15名の委員は今申しましたような問題意識に立脚いたしまして昨年の11月に発足以来合計20回にわたって8月5日に20回目が開かれたわけでございますが議論を進めて今申しました8月5日の最終回においてこの報告書を取りまとめることができましたそこでまず私ども社会保障制度改革国民会議の役割といいますかあるいはそもそも設立に至る経緯から説明を始めさせていただきたいと思いますご承知の通りこの社会保障についての有識者会議というのはこれまでも何度も開かれております過去10年15年ぐらいで言えば小淵内閣の頃からこの議論が本格化したかと思いますがとりわけ最近の10年以内のことで言えばご承知のとおり2008年だったと思いますけれども、福田内閣によって社会保障国民会議において、私もこの社会保障国民会議の第二文化会、年金と雇用の文化会の座長を務めましたけれども、社会保障の持続可能性の強化、そして機能の強化についての具体的な提言とめられたわけでございますけれども、その提言においても実はこの福田麻生内閣以来の社会保障国民会議で取りまとめられた提言の基本的な方向性というものは引き継がれたわけでございますすなわち一方で社会保障制度の持続可能性を高めつつ他方でその給付の充実を図るとあるいは給付の合理化重点化を図るという方向性でございますこうした自民公明そして民主党という異なる政党によって作られた政権下で有識者会議が基本的には同じ方向性の報告書を取りまとめたということもありまして、社会保障の具体的な制度改革と税制改正されて、当時与党であった民主党、そして今、今度は与党になった自由民主党公明党の3党で確認書が合意されたわけです そしてその確認書に基づきまして3党の提案で社会保障制度改革推進 法が国会に提出され昨年の8月に成立したというのが昨年ちょうど 1年前のことであったわけですつまり今申し上げましたように 2008年の社会保障国民会議以来の社会保障制度改革の議論については政権交代を超えて共有できる一連の流れというものができてきていたわけでございますその意味でこの与野党三党間で合意がなされたというのはこの与野党というのは当時は自民民主党が与党今は自民公明が与党ですけれどもいずれにしてもこの与野党間で合意がなされたというのは私は日本の社会保障制度改革史上極めて画期的なことであったというふうに評価をしておりますつまり政権が交代しても社会保障制度改革の目的と政策の方向性は基本的に大きく変わることなく引き継がれたということでございますこのことによって国民は政権が変わるたびに社会保障制度が変わったりするというような心配をしなくてもいいつまり国民に安心を与えそして社会保障制度をしっかりするというような心配をしなくてもいいつまり国民に安心を与えそして社会保障制度をしっかりと将来に引き継ぐことができるという枠組みができたわけでございましてその意味で私どもはこの三党合意がなったということは歴史的にも評価されるべき改挙であったというふうに思っているわけでございます。今回の私どもの社会保障制度改革国民会議は、そうしたこれまでの議論の成果を引き継いでその上で改革の実現 に向けてさらに議論を深めて具体的な制度改革の方向性あるいは スケジュール感というものを示したわけでございますがその上 で改めて従来の有識者会議等との性格の違いあるいは従来ののそうした有識者会議等から出された提言と異なる点というものを申し上げますと、次の3点改革、つまり税と社会保障の2つを一体的に改革するということで、社会保障の機能強化のための安定財源としての消費税がこの改革の前提となったということで、このためにより具体的な提案ができるということであります この点が政治の場において提言が具体化されるということを財政 的に担保することになっている点これが1点目でございます 2点目は国民会議は先ほど来申し上げておりますように3党合意に基づく 改革推進法の下で設置された会議は先ほど来申し上げておりますように、三党合意に基づく改革推進法の下で設置された会議でございまして、そういう面では改革推進法という法律によって、しっかりと根拠と、しかも改革推進法の基本的な考え方であるとか、あるいは改革の方向性というものを踏まえて議論するということが定められているというある面で言えば議論の枠組みあるいは国民会議のミッションというものが明確に定義され与えられているということでありますこのため私どもはその枠組みの中で今度は専門家として深く論理的実証的な議論を積み重ねることによって、より具体的な提言を作成することができたというふうに思っております。そして3つ目には、この報告書を踏まえて、政府が法制上の措置を講ずるということが、改革推進法の中で定められているということでございますこのことによってこの報告書で提言した内容が最終的には政府によって法制化され実現化するという方向に必ず進むことがこの改革推進法の中であらかじめ規定されているということでありますその意味 では私ども今回の報告書に盛り込んだ改革項目については政府 においてあるいは政治の場において必ずそれが実現されるということ を期待できるという点が3つ目の特徴かと思っておりますそこでそうした会議の中で20回にわたる議論を経て作られた報告書が皆様の手元にも今日配られているかと思いますが社会保障制度改革国民会議報告書という表題がついた報告書でございます。その下に副題が、確かな社会保障を将来世代に伝えるための見出しという形でついておりますが、まさにここに副題に書いたことが、この報告書の私どもとしては最も言いたかったことでございます報告書の構成でございますけれどもページを開いていただきますとまず最初に私の名前で国民へのメッセージというものを置いてございますその中では特に今最初に申し上げましたようにこれから高齢化がますます進んでいく中で社会保障制度の持続可能性を高めるためにも改革が必要であるとただしそれはどうして必要かというとそもそもこの改革を必要とする原因となった高齢化自体が社会保障制度の成功の結果であってその世界に勘たる社会保障制度を将来世代に伝えるために改革が必要なのだということを強調しております特に社会保障制度の持続可能性を高めその機能がさらに高度に発揮されるようにするためには、このメッセージの左側のページの一番下のところに書いてありますけれども、社会保険料と並ぶ主要な財源として国地方の消費財源を税収をしっかりと確保し、能力に応じた負担の仕組みを整備すると同時に、社会保障がそれを必要としている人たちにしっかりと給付されるような改革を行う必要があるというふうに述べておりますそれからもう一つ強調したのはそのためにもですねこの社会保障制度を支える現役世代特に若い世代の活力を高めることが重要であって子育て支援などの取り組みはそういう面では社会保障制度の持続可能性を高めるためにもちろん必要ですがそれだけではなくて日本の社会全体の発展のためにも不可欠であるということだからこそこの報告書の中で述べている先ほど武田さんもちょっと触れてくださいましたけれども前世代型の社会保障というのが求められているわけであって納得性の高い社会保障制度の下でですね、国民がそれぞれの時点でニーズに合った給付がしっかり受けられるようにしていくことが大切だということを述べております。その次にページをめくっていただきますと報告書の目次というものがございますけれども報告書は大きく一部二部というふうに分かれております一部においては社会保障制度改革の基本的な考え方全体像というものを示しておりますその目次にございますように社会保障制度改革国民会議の使命ということで今申しましたようなこれまでの経緯等が述べられておりますそして2つ目に社会保障制度改革推進法の基本的な考え方ということを2ページ目のところから述べているわけでございます事情・共助・控除の最適な組み合わせ、あるいは社会保障の機能の充実咀嚼して、そしてもう一つ給付と負担の両面にわたる世代間の公平といったような、大きく分ければ1から4までの基本的な考え方というものを示しておりますそれから社会保障制度改革の方向性ということについて1970年代モデルから21世紀日本モデルへということで人口構造あるいは就業構造の変化等に対応して社会保障制度を変えていくということそれから先ほどもらい申し上げているように全ての世代を対象として全ての世代が相互に支え合う仕組みそれから女性若者高齢者障害者など全ての人々が働き続けられる社会さらには全ての世代の夢や希望につながる子ども子育て支援の充実そして低所得者不安定雇用の労働者への対応さらには地域づくりとしての医療介護福祉子育てそして国と地方が共同して支える社会保障制度改革成熟社会の構築へのチャレンジといったような形で、社会保障制度改革の方向性について伸びております。そして最後に、この改革のスケジュール感といいますか、筋道を時間軸で考えるということを述べてございます。具体的な改革のありようについては第2部のところで少子化対策分野 の改革それから医療介護分野の改革年金分野の改革という形で 述べてございます一つだけもう時間がございませんので詳しい ことはこの内容を読んでいただければと思いますがこの構成を見ていただく とわかるように、一番最初に、格論の一番最初に、少子化対策分野の改革というのを挙げさせていただきましたそれに続いて�っていただければと思いますまた後ほどご質問があったらお答えしたいと思いますが先ほど改革推進法に規定された基本的な考え方というふうに申し上げたわけですがこの基本的な考え方の中で特に日本の社会保障制度の特徴について触れておりますのでこの点について少しだけお話をしておきたいと思います先ほども申しましたようにこの改革推進法においては日本の社会保障制度というのは次女・強女・後女の最適な組み合わせに留意してこれを形成すべきであるというふうにされているわけでございますがこれは国民生活というのはまずは自らが働いて自らの生活を支えそして自らの健康は自ら維持するという事情を基本としながら一方で高齢であるとか疾病介護といったことをはじめとする生活上のリスクに対しては、社会連帯の精神しっかりと定めた上で、必要な保障等を公費によって行う。例えば、公的不条であるとか、あるいは社会福祉といったような控除がそれを補完するという組み合わせでございます したがってこの日本の社会保障制度においては特にこの教助の部分国民介護権 介念金に代表される教助の部分を構成する社会保険制度が基本になるとそもそもこの社会保険というのは例えば年金であればもともと子どもが親を扶養していたものあるいは介護であっても子どもが親を介護していたというようなこの事情の部分を社会化したというような部分もあるわけでございましてそうした国民解放権、解年金というのが全ての国民が医療保険や公的年金による保障を受けられるようにするという制度でありましてこのことが日本の社会保障の中核として国民生活を支えてきたしこれからもその役割を果たすべきだというのが我々の考え方でございますこうしたこの社会保障制度特に社会保険の財源社会保険でございますからもちろんその体操はその保険に参加している人たちの保険料によって賄われているわけでございますが特に日本の社会保険制度の特徴として保険料負担に加えて税財源いわゆる公費も投入されている。つまり日本の社会保険制度の中には、例えば所得等の面で保険料の負担がなかな減であるとか、あるいは保険制度間の負担と給付の不均衡といったようなものを調整するために、一定程度公費、すなわち税財源が投入されているというのが特徴でございます。そのことが先ほど言いましたように、国等の借金を増やす原因にもなっているということでございます一方でこの高齢化さらには高齢化だけではなくてですね医療などについては医療行為そのものの高度化などのためにこの社会保障給付というのは実は経済成長を上回って継続的に増在しているわけですねこうした中で既存の社会保障の安定財源というものを、つまり今までのこの社会保障制度をしっかりと確保するための安定財源を確保して、同時にこの社会保障の機能の強化を図るためには、もちろん一方では消費税の増税といったような税の負担増あるいは所得 の高い人にはもっとしっかりと保険料を負担してもらうという 形での負担増は避けられないわけですがこうした負担についての 国民の納得を得るとともに持続可能な社会保障を構築していくためにも一方で徹底した給付の重点化効率化という ものが必要であるというふうに考えているわけでございます 国民会議では以上申しましたような基本的な考え方に基づいて議論 を重ねてきました冒頭にも申しましたようにまた報告書の国民へのメッセージ も書きましたように日本における長寿社会の実現というのは社会 保障制度の充実のおかげでもありますが、その高齢化によって今度は社会保障制度の持続可能性が問われることになっているということを考えますと、やはりこの世界に勘たる日本の社会保障制度の将来を将来世代にしっかりと伝えるためには、現在の世代が何らかの努力をしていかなければいけないということを議論した内容でございます報告書ではこの大きな方向性として主として高齢世代を給付の対象とする社会保障から切れ目なく全世代を対象として必要とされる社会保障が全ての世代の国民に確実に寄付される社会保障へと転換すること そのためには年齢ではなくて負担能力に応じた負担の仕組みを整備するということこのことの改革の筋道を示しております まず少子化対策分野に関して言いますとこの度の一体改革の中で実は子育て支援が重要な柱として位置づけられ子ども子育て支援新制度が設けられてそれについて高級財源が確保されました消費税の増税分から0.7兆円の高級財源というのが確保されているわけでこれは歴史的に大きな一歩と評価すべきだろうと思います少子化の問題というのはそういう面では社会保障全体に関わる問題であると同時に子育て支援はその子どもを育てている家族のためだけではなくて社会保障の担い手の確保という面であるいは経済成長という点からも大きな貢献をなす改革でございますので、全ての世代にとって子育て支援を中心とする少子化対策というものが重要な課題であるというふうに位置づけております。具体的には今申しましたように消費税財源によって待機児童を解消すべく子育て支援政策を格段に救命であるとか延命であるとか、そして治癒、社会復帰というものを前提とした、いわゆる病院完結型の治す医療であったわけですけれども、平均寿命が伸びて高齢者が増えた社会においては、むしろそれも大切ですけれども、そうした高齢者に多い慢性疾患の受領が多くなりまして、しかも高齢者の場合には複数の疾患を一人の方が同時に抱えるといった特徴を持つようになります。このために治す医療も大事ですけれども、高齢者にとってはむしろ病気とある意味では共存しながら生活の質を高めるということべきだということをしております。それから年金分野に関しましては、将来的にどのような制度体系をとるにしても必ず必要になる課題をまず解決すべきだと。そして将来の制度体系については引き続き議論をするという、いわゆる2段階のアプローチを取ることといたしました。その上で当面必ずやらなければいけない年金の持続可能性を高めるための例えばマクロ経済スライド制の徹底といったようなことあるいは一方では給付の所得保障機能を充実させるために非正規労働者の費用者年金への加入を進めるといったようなことあるいは世代間の負担と給付のバランスを取るという悩みからも年金給付課税について特に所得の高い人についてはこれを見直応じた負担を強調しておりますので、消費税の引上げに加えて、さらに負担増になる人たちがいらっしゃるということは確かでございます。しかしこれは将来の世代の負担を軽減し、そして社会保障制度の持続可能性を高めるためには不可欠であるというふうに私どもは考えております。現在の世代の中の負担能力のある人たちの負担を高めて、将来世代の負担の伸びを軽減するということがその目的でございます。そのためにこれまでの年齢別から負担能力別の負担のあり方に切り替える必要があるということを示しておりますまた同時にこのことによって現在の世代においても低所得者の人々にとっては例えば国庫の保険料や介護保険の保険料の軽減等を行うことができるわけですしそういう意味では低所得者に対する配慮が行うことができる。したがって、確かに一部の高所得者の方、高齢者の中でも所得の高い方には負担増をお願いするというようなことになるかと思いますが、それと同時に所得の低い方には保険料の軽減等が行われ、また何よりも次世代の育成の支援の強化にも取り組むことがそれによってできるまた将来 世代の負担を軽くすることができるという点を私どもとしては強調 したいと思います8月5日の20回目の国民会議の終了後最終的な報告書 の形式に取り まとめまして8月6日に安倍総理にこの報告書を渡し議論の経緯等 をご説明させていただきましたその際私の方からは改革推進法 においては8月21日までに政府において国民会議の結論を参考に して法制上の措置を講じていただくことになっていますので社会保障�制度改革の前提となる消費税による財源の確保をしっかり行っていただくとともに報告書に書かれた改革の方向性とスケジュールをぜひ政府の法制上の措置に反映していただいて必要な社会保障制度改革を速やかにかつ着実に実行していただくようお願いをしたところでございます最後になりました けれども国民へのメッセージのところでもご紹介しております が私ども慶応義塾の創立者でございますが福沢諭吉は学者は国の土岸なり というふうに書いております土岸とは狩りの群れが一心に餌をついばんでいる時に、一羽首を高く掲げて遠くを見渡して、何に備える役割をする狩りのことを言うそうでございまして、福沢は学者もまた、今世の有様に注意して、つまり現状を冷静に分析して、もって後日の特質を論ずる。すなわち将来にとって何が良いかを考える役割を担うべきだということを申 しております私たちもまた社会保障の専門家として社会保障制度 の将来のために何が良いことかということを論理的実証的に議論 してまいりましたこの報告書は日本を世界一の長寿国にした世界 に勘たる社会保障制度を将来の世代にもしっかりと伝えるために、現在の世代はどのように努力をしたらよいのかということを考え抜いた私ども国民会議の結論でございます。各層の国民各層にこの報告書が読まれ、幅広く関心を持っていただいてご理解をいただければありがたいというふうに思っております少し時間をオーバーしてしまいましたけれども私の方からは以上でございますどうもありがとうございましたどうもありがとうございましたそれではこれから早速質疑応答に移る前にまず私の方から2点だけ聞かせてください今最後の方で今政家さんもおっしゃられた通り21日までに法制上の措置を取る、つまり内閣の側でプログラム法案の個市を閣議決定する。何をいつやるということの個市を閣議決盛り込まれているわけですが、年次が書かれているものもあれば書かれていないものもありますね。そういうことをすべて含めてまずこのプログラム法案、スケジュールがここで盛り込んでほしいのか、念じとして何をまず優先的に取り組んでもらわなければいけないと考えておられるのか、いくつか例示していただけますか。もちろん報告書に書かれたことは全て大切なことなので、私からどれが特に大切でどれを先にということはスケジュールとしてなかなか申し上げられませんけどスケジュールとしてはご承知の通りもう書き込まれていることはございます例えば地域医療ビジョンそれから国民年金の都道府県を保険者にするということについては、国保ですね。国保健康保険を都道府県に保険者にするということについては、次の医療制度の改革2018年から予定されているそれまでに行っていただきたいということが決まってございますのでそういう面ではそれから例えばいわゆる費用者保険が後期高齢者の支援金を総報酬割、これは2015年ぐらいまでにやっていただきたいと思います。そういう日程が書き込まれたことはその通りにやっていただきたいと思いますその他のことについてもいろいろとスケジュール感は書いておりますけれども何がまずということはございませんけれども少子化対策というのはもうすでに子ども子育て3法というものが前の国会で成立しておりますのでまずはこの子ども子育て3法の着実な実現を図ってですねそして速やかに例えば待機児童を解消するこれはやっぱり何度も言いますけどもどれも大切ですけれども、やっぱり速やかにやっていただきたいと思います。まさにそれはこの小建ての中でも一番最初のところに書き込んでいるわけでございまして、そこのところはしっかりとやっていただきたいなと思っております。それからもう一つは、特に少子化対策というのは、やっぱりもうすでに相当少子化が進んで、例えばこれからお母さんになる方々の人口そのものもどんどん縮小していくわけですからそういう意味から言ってもスピード感を持って子どもを産み育てたい人たちが子どもをきちんと産み育てることができるような政策というのを速やかに進めていくということが大切だと思う。だからもう一つスピード感を持ってやっていただかなければいけないのは、さっきもちょっとスケジュールがあると申しましたけれども、医療の提供体制、あるいは医療保険制度の改革の押しまでにやっていただきたいことをやっぱりこの医療給付というのは年金以上にご承知のとおり伸びているわけですから、この医療介護の給付を適正化すると同時に、その提供体制を見直すことによって、さっき言いましたように、高齢者自身の生活の質を高める。今は年を取った方がいろんな病気を抱えていろんな病院を回ったりしなければというような状況があるわけですけどもそういうようなことが解消されるような形で改革が速やかに行う必要があるのではないかなと思います逆に言うと中長期的に検討すべきと言っている課題もありますのでそれは中長期的にしっかり検討していただくただちょっと繰り返しますが私は特にどれが大切でかそういうことを言える立場ではありません多分正規さんお答えにくいだろうなという質問をあえて聞かせていただきますあと一点ですこれも先ほどのところで、関さん、多分故意的に触れられたと思うんですが、消費税です。社会保障と税の遺体改革、今回の国民会議、今までの国民会議と最大の違う点は財源のあるところと、消費税の手当がついているところ、だけどその消費税そのものが引き上げられるかどうかは今まだ不透明な部分が残っています。もしこの消費税、引き上げ延期と見送りというようなことになった場合に、どういう影響が具体的に懸念されますか。これは難しい質問ですけれども、これは、先ほども申しましたように、税と社会保障一体改革を進めるという三党合意に基づいて作られた社会保障制度改革推進法文字通り一体改革でございますから、税の改革、すなわち消費税を来年4月には8%、それから再来年の10月には10%に引き上げるということを前提に、それによって消費税財源が確保されるということを前提にこの改革は述べられています例えば典型的には先ほど申しました子ども子育ての部分これは消費税の引き上げによって0.7兆円の財源を確保するということが前提でも書かれてございますのでもし引き上げられなかったらというご質問にはなかなかお答えにくいですけれども、我々として申し上げられるのは引き上げられるということが前提でこの報告書は書かれているので、ぜひ我々の立場から言えばですね、これはもちろんいろんなお考えあると思いますし、最終的には政府が法律に従って消費税の引き上げそのものあるいは引き上げ時期をお決めになると思いますが少なくともこの社会保障制度改革国民会議の会長という立場あるいは報告書を提出した立場から言えばこの報告書はあくまでも消費税の予定通りの引き上げが前提で書かれているのでそしてこれが実現されるためにはその前提が必要であるということは申し上げなければいけないかというふうに思っております。それではさすが会場の方々からご質問をお受けしたいと思います。どのあったかご質問ございますか。挙手をお願いしますお名前できれば所属といったことを最初につけていただければと思いますどうぞ日本経済新聞の大林と申します年金改革について一点お尋ねします政家さんがさっきおっしゃったようにこの年金のパートはですねすぐにやるべき改革とその後中長期的に考えるパート2つに分かれている。それは私もそれでいいと思うんですが、ちょっと確論で恐縮なんですけれども、支給開始支給開始については具体的に見直しを行う環境にないということから中長期的課題として考えるということが書かれているということで支給開始年齢は中長期の課題というふうに位置づけられていますそのページの中ほどにですねというふうに位置づけられています。改革によって年齢を変えても長期的な給付総額には変化はないということが書いてあります。これはですね、つまり支給開始年齢を引き上げても年金財政に具体的にプラスの効果が認められないというふうに読めるんですけれども、そういう理解でよろしいのかどうかというのは社会保障審議会などではこれまでもこの問題 何度も議論されてきて厚生労働省の試算によると例えば一切引き上げる と5000億程度の公費削減効果があるというような数字も当局から出ているわけですねだとするとこの長期的に総額は変わらないということとどういう関係にあるのかというのがちょっと理解しにくいこれは私も取材しましたけれども納得できるような説明をまだ受けていないものでぜひ正家さんに解説をいただきたいと思います。よろしくお願いします。はい、わかりました。まずここに書かれている今大林さんが言われた内容というのは、2004年の年金制度改革においてご承知のとおり、その時もすでに年金の支給開始年齢のスケジュールというのが決められていて、最終的に男性の場合20253%、それから国民年金の場合には当時の価格で16,900円にキャップが定められて、その上限を維持するために、これもご承知のとおりマクロ経済スライド制が導入された。そういう意味で、もう年金の支給開始年齢のスケジュールが定められそして給付の上限が定められそしてマクロスライド性があるわけだからその2004年の改正のスキームの中では支給開始年齢を引き上げなくても年金の持続可能性は担保されているということですね確かにその意味では年金の支給開始年齢の引き上げをしないと年金の持続可能性が低下するとかいうことはないというのがここに書かれていることだろうというふうに理解しています年金の支給開始年齢の引上げというのはおそらく年金財政に寄与するのは給付の全体が決められていない場合はつまりこの2004年改正というのは給付の上限が決められそしてその上限が守られるようにマクロ経済スライドという形で給付水準が決められてこの総枠が決まっているわけですからその中で年金の支給開始年齢を変えれば例えば給付水準がマクロスライドがそれだけしなくて済むという形で、多分増える、給付水準がマクロ経済スライドで決まるようになっている。その限りにおいては、市給開始年齢の引き上げというものが財政マクロ経済スライドを例えばしなくて済むということになるかもしれませんけどもいずれにしても変わらないただ私は年金の支給開始年齢を引き上げることによって例えば今言った観点で言えば実はマクロ経済スライドというのは今はデフレですから実際されていませんので、そんなに大きな影響はないですけれども、実際にマクロ経済スライドが行われるようになれば、これはご承知のとおり年金給付の実質給付額が削られるわけですから、そういう面では年金受給者にとってはかなり厳しいわけで、それをむしろ抑制するというか、マクロスライドによる実質の減少幅を抑えるためには支給開始年齢を引き上げるというようなことはあり得るだろうというふうには思います。それからもう一つは、年金財政の話だけではなくて、年金以外の社会保障給付、これはどんどん増えていくわけですから、これを賄うためにもっと高齢者の引退年齢を引き上げて、その人たちに社会保険料や税を負担してもらって社会保障制度全体を支えるという意味ではそれもあり得るだろうというふうに思いますですから2004年何度も繰り返しますけど改正の下では必ずしも年金の支給開始年齢を引き上げなくても、年金の持続可能性には引退年齢を引き上げていくということは意味があるのでそういうことは中長期的にやっぱり生涯現役社会という視点で議論すべきというふうに申し上げているわけですこの辺はちょっと私自身の考え方とこの報告書の考え方必ずしも一致していないところがあるかもしれませんけれどもそういう面でもう一度言いますと私の理解は年金自体の財政上の観点から言えば2004年改正において負担のキャップが定められそれに見合うように年金の支給開始年齢がたとえ最終的に65歳のところで止まったとしても給付水準がマクロ経済スライドによって調整されるので持続可能性は担保されたとそれは言えると思いますただ一方で年金の支給開始年齢を引き上げることによってマクロ経済スライドの下げ幅を、実質給付の下げ幅を緩和したり、あるいは社会保障制度全体の持続可能性を高めることに寄与したりすることができるというふうに考えております。政権さん、今のお答え、政権さん自身もなかなか本当は答えづらいと思いながら多分答えられているんだと思いますけれども、ここは実は私も非常に違和感を持って受け止めたところで、つまり今の政権さんのお答えはこういうことですよね。2004年に大きな改正をしましたと、その時にいくら払っていくらもらうかというのはもう大枠が決めたんだから、それがきちっと計画通りうまくいっている中では、この給付年齢を上げようが下げようがまたそれに応じてこの経済スライドなんかでさらに調整したりするので、実際の長期的な総額に対する影響はないんだとだからあくまで2004年 の計画通り今全てうまくいっていればという前提ですよねだけど 今多くの人が考えているのはもう2004年のあの計画は相当今危なく なってるんじゃないかもうその一つの客観的な証拠が積み立て金の枯渇ですよねあの当時要するに決めたことは将来団塊ジュニアの世代が年金受給者になったあたりこのあたりが一番危ないと一番お金が足りなくなるのでその時のためにできるだけ虎ノ子の年金積立金はできるだけ積み増していきましょうと。できるだけ増やしていきましょうということをあの時の計画になったんですけど、今逆にどんどん物価スライドも凍結をしたりして、年金給付の方を厚くしたがために今何が起きているかというと積立金を貯めるところが取り崩してしまってだいたい全部で150兆ぐらいあった積立金が今110兆ぐらいまで行っちゃってるんですかね120兆か10兆ぐらいですよねどんどん減っているわけですよねこんなことをやっていたら持続可能性が保たれなくなるんじゃないかと。100年安心じゃ全然ないんじゃないかと。だからそのためにできることはいろんなことをやり基準年をもっと引き上げるという意味個人的には70歳に引き上げてもいいと思うという発言をされて、本当は政権さんもそのために言われていたわけですよね。だからこの政権さんの本来今までおっしゃっていたことと、この文章のこの部分というのは相当違和感を感じるんですけどね。これは国民会議の報告書ですので、そして私は決して冗談ではなくて、今日は国民会議を代表して説明に伺っております。国民会議の中でもいろんな意見がございました。いろんな意見がございましてこの報告書の中には国民会議で議論されなかったことは出てきません国民会議の委員はいろんな意見がありますからそれらの中で大方の賛同を得たことがこの報告書の中に書き込まれていてもちろん私の意見が反映されている部分もあるし、残念ながら反映されなかったところもあります。それはまず一つですね。年金の何て言うんでしょうかね今武田さんが言われたことは私は正しいと思いますが一つだけ積立金について言えばこれはまさに一つはしっかりとマクロ経済スライドとかですねそういうようなものをやることが必要だということはこの中にも書いてあるわけですが、同時に積立金についてはこれは様々な市場環境といいますか、運用環境によっても左右されるわけですね。ですから一時厳しい市場環境の下でそれがずっと続くという前提で、将来枯渇するというような予測をすることももちろんできますし、その固めの予測というのは大切だと思いますけれども、最近例はまた少し市場環境も変わってきたりしているので、そこのところは一概に何年に枯渇したりすることがないように、この中にも書いてありますけれども、給付の適正化というものを行ってくださいということは言っておりますので、確かにここに言われているようなことが適切になされない場合には度の持続可能性については担保されるというのがこの報告書に書かれていることそれは決して私の持論にも反するということではないただ私はこれはちょっと報告書ではなくて自分の考えを言えばさっき言いましたように武田さんが言われたように社会保障全体の負担と給付の関係から言った時には、支給の開始年齢の引上げというのは考える価値が十分にあると思いますし、それから日本は世界で一番寿命が長くて、それから高齢化比率も一番高いわけですから、そういう面では働く意思と仕事能力のある人ができるだけ長く働けるような仕組みにしていくそしてそういう意味でさっきおっしゃった年金のまさに基準支給開始年齢を引き上げていくというのは例えばご承知の通りアメリカも今支給開始年齢要するにフル年金の支給開始年齢67歳に引き上げに向けて、もうその途上にあるわけですし、ヨーロッパの一部の国進んでいるわけですから、支給開始年齢の引き上げというのをここに書いてあるように長期的には検討してもいいのではないかなというふうには思います。ですがそれはちょっと私の個人的な意見ということで申し上げます。日経大林さんよろしいでしょうか。それではもう時間がかなり来てしまいました。あと一問だけご質問をお受けしたいと思いますけれども、どなたがございますか。はい、お願いします。すみません、個人会員の原田と申します非正規職員非正規の社員ですね社員じゃない非正規で働く人たちのことはこの中に国民健康保険と年金制度へどうやって取り組んでいくかというようなことを取り組むのが望ましいと書いてるんですがなかなかアイデア私なんか個人的には全然分からないんですがお話の中でこの非正規の人たちを加入している人もいるしいない人もいると思うんですけどどうやって国民健康保険国民買い年金とですね買い保険制度と年金制度に取り組んでいけばいいのか何かアイデアみたいなものがございましたか具体的な施策はこれから政府において具現化されるかと思いますけれども私どもはやはり費用者の保険あるいは費用者の年金にはやはり費用者は原則としてみなそちらの方に加入するというのが多分原則だろうというふうに思っておりますそれは一つにはですねこれはこの報告書の中には特に強調はされておりませんけれども例えば労働時間の短い人は費用者年金に加入しなくてもよいというような制度がそういう制度自体が他の条件一定の下で非正規の雇用を増やす。そういう面では制度そのものが一定の雇い方あるいは働き方をするとお得だよというような形になっているというのはそもそもあまり望ましいことではない。それからもう一つは、やはり費用者というのは仕事を辞めた後、例えば年金で言えば所得がなくなって生活が大変だから、そういう意味で費用者の年金は自営業者の年金とは別のものにしましょうという趣旨があるわけですからそういう面ではやはり例えば非正規というような働き方をしている方であっても費用者である以上それと同じやっぱり趣旨にもっとってですね費用者の年金に加入してもらうのがいいだろうというふうに思いますただこれについてももちろん現状において一定の人たちは加入していないあるいは雇い主としても加入させないで済んでいる部分がありますからご想像の通り様々な抵抗というか困るというような声は出てくると思いますのでそれをどこまであるいはどういう方法でやるかということは具体的に政府において決めていただきたい特に労使の合意が成り立つような形で決めていただきたいと思っていますが、基本的な方向性としては、費用者は費用者の年金や保険に加入すると同時に、そうした制度が一定の働き方というものを誘導したりすることがないようにつまり働き方について国の制度ができるだけ中立的であるようにしていく必要があるというふうに思っておりますパートの人たちなんかの特に厚生年金への適用拡大相当壁が事業者側の壁が厚いですよね。まあそうですが、そうだと思いますが、ただ別の言い方をすれば、パートでないフルタイムの人たちを雇っている事業主は、そういう面では競争上不利な立場になって、雇って今厚生年金の保険料を払っていない雇い主と正社員の人たちをたくさん雇って保険料をしっかり払っている雇い主では当然利害が違ってくるわけでそもそもそういうことが発生しないようにどんな雇い方をしても雇い主のポジションは変わらないようにすべきではないかと思いますおっしゃる通りこれまでのいろいろな経緯を見てもなかなかそこは大変な部分はあるかなと思いますが、しかしそこはしっかりと政治のリーダーシップにおいて進めていただきたいなというふうに思っております。税制優遇とかいろんな手立てをこうしてできるだけ入ってもらえるように、事業者がそれに応じてもらえるようにいろんな手立てを講じる必要があるということですよね。どうもありがとうございました。そろそろ時間になりました。いろんな手立てを講じる必要があるということですよね。どうもありがとうございました。そろそろ時間になりました。まず、こうやって記者クラブで講演していただける方には、最初に一言書いていただくことになっているんですけれども、今日、清潔さんがお書きになったのですが、それだけ今取り出してきたものなんですけれども、こういうことを清潔さんがお書きになったのですが、それだけ今取り出してきたものですが、こういうことを清潔さんにお書きになりました。確かな社会保障を将来世代に伝えるための道筋。これは報告書の副題を貸していただきました。とにかくこの方向をちゃんと守ってやってくれということですね。最後、これが講演していた方に差し上げているネクタイなんですけれども、いろんなパターンがあるんですけれども、全てトラディショナルなネクタイですけれども、政家さんはグリーンのネクタイを選ばれました。本当にどうもありがとうございました。もう一度拍手をお願いします。ありがとうございました。ありがとうございました

【第4章】インフラ設計:VRAM 128GBを使い切る「逆算の設計美学」 インフラ設計とは、単にスペックを並べることではありません。利用可能な128GB VRAMという有限の資源から、いかに最高密度の知能を導き出すか。そこには、安定稼働という「実務上の誠実さ」から逆算された、確かな設計思想が求められます。

ユニファイド・メモリの特性とシステム・フリーズのリスク 今回の検証機(DGX Spark 互換機)の特徴 は、Grace CPUとBlackwell GPUが超高速に直結されたユニファイド・メモリ(統一メモリ) 構造にあります。この構造はデータの転送ボトルネックを解消する一方で、インフラ設計においては「システム領域との干渉」という特有の課題を突きつけます。

GPU側で過剰にメモリを確保した場合、OSを含むシステム側の動作領域が瞬時に枯渇します。120B級の重厚なモデルをロードし、広大なコンテキストを展開しようと試行錯誤する過程では、OSが一切の入力を受け付けなくなるシステム・フリーズが繰り返し発生しました。この強制リセットを余儀なくされる状況は、統合アーキテクチャにおける領域管理の難しさを示しています。

知能の「体積」を計算する:120B 4ビットという選択 128GBというキャンバスに対し、まず動かすことのできない「固定領域」を配置します。

領域

容量 (GB)

役割

性質

Model Weights

~70GB

120B 巨大知能本体 (MXFP4)

固定

KV Cache

~38GB

読解の作業領域 (総収容:1.3M 〜 4.1M tokens *)

変動

System Buffer

~20GB

誠実な余白 (OS・フリーズ防止用)安全枠

* KVキャッシュの量子化(FP16 / Q8_0)に加え、長尺読解か多重処理かというタスクの性質に合わせた「並列スロット数 × コンテキスト長」の最適化により、総収容数は変動します。

30B級モデルであれば、システム領域に配慮しても余裕を持って動作します。しかし、医療や政策といった「言葉の重み」が問われるドメインでは、30Bによる「要約という名の情報欠損」のリスクを考慮し、システムリソースを極限まで活用してでも120Bを選ぶ必要がありました。これは解析の質を担保するための、実務上の判断です。

「32,768 × 40」:モデル特性に基づくリソース配分 後述の再現レシピ(docker-compose) で設定した -c 1310720(約1.3Mトークン)と -np 40(40スロット)という数値は、モデルの仕様とハードウェアの安定性を両立させるための均衡点です。

1,310,720 ÷ 40 = 32,768

( Total Context / Parallel Slots = Tokens per Slot )

この設計の起点は、Swallow-120Bの学習データセットおよび開発元が推奨するコンテキスト上限である32,768トークンにあります。この「1スロットあたりのサイズ」を固定した上で、BlackwellのVRAM空間においてシステム側の安定性を損なわずに展開可能なスロット数を検証した結果、40スロットという構成が導き出されました。

物理メモリをロック(mlock)し、スロットを小分けに管理することで、ユニファイド・メモリ環境におけるメモリ断片化や、突発的な計算スパイクによるシステム破綻を回避しつつ、将来的な多重リクエストへの拡張性を確保しています。

20GB の余白が担保する安定稼働

nvidia-smi のログが示す約108GB の占有と、あえて残された約20GBの余白。

これは保守的な設定ではなく、繰り返されたハングアップから導き出された安全策です。推論時の計算バッファやKVキャッシュの動的な増大を、この20GBの余白で確実に吸収します。120Bという巨大な知能を実務で継続的に回し続けるためには、この余白の確保こそが、設計における誠実な境界線となります。

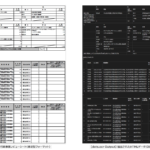

【第5章】システム環境とスペック詳細

【本章の読み方】 ※ 以下は本記事公開時点(2026年3月)の llama.cpp / MXFP4 検証環境です。※ 2026年4月時点の vLLM / NVFP4 構成については、本章末尾に追記しています。

本検証における推論環境を記録します。580系ドライバおよびCUDA 13という最新環境下において、Blackwellのポテンシャルをネイティブに引き出す構成としています。

検証環境スペック

技術的特記事項: DCMAKE_CUDA_ARCHITECTURES=121 を指定。Grace-CPUとBlackwellが直結されたユニファイド・メモリアーキテクチャに最適化させたバイナリを使用しています。※ 注:本記事における「Native FP4」は、BlackwellのFP4演算命令セット(MXFP4等)をエンジンの計算過程で活用する構成を指しており、モデルの全パラメータがFP4のみで構成されていることを意味するものではありません。

2026年4月追補:vLLM / NVFP4 検証環境 本章のMXFP4構成に対し、2026年4月時点ではvLLMによるNVFP4構成での検証も行っています。

※ llama.cpp環境でも -np による並列スロット指定により複数リクエスト処理は可能ですが、スロット単位の固定割当となります。

vLLM image:nvcr.io/nvidia/vllm:26.03.post1-py3

OS:NVIDIA DGX OS 7.5.0(Ubuntu 24.04.4 LTS)

Driver:580.142

CUDA:13.0

GPU:NVIDIA GB10(Unified Memory 128GB)

【第6章】再現レシピ:Docker Compose & Dockerfile 公開 2026年4月追補:vLLM / NVFP4 用 Docker Compose vLLM / NVFP4構成では、Qwen3.5系とNemotron3系で基本構成を分けています。

配布元による差分は、モデルIDのみを差し替える形で整理しています。

系統

配布元

差分

Qwen3.5

RedHatAI / Sehyo / txn545

モデルIDのみ差替 。Qwen3.5-0.8B トークナイザーを指定。

Nemotron3

RedHatAI / Unsloth

モデルIDのみ差替 。chat-templateを指定。

本検証では、単純な最大並列数ではなく、コンテキスト長とKV cache使用量のバランスを重視した設定としています。

Qwen3.5-122Bでは、256kコンテキストを確保しつつ、vLLM側の max-num-seqs を4に設定しています。計算上はさらに並列数を増やせる余地がありますが、本検証では長時間運用時の安定性とKV cache使用量の急増リスクを考慮し、4並列を実用上の安全側設定としました。

一方、Nemotron3-120Bでは1Mコンテキストを優先するため、max-num-seqs は1に抑えています。これは、並列数を追うよりも、長文・高複雑度入力を安定して処理することを重視した設計です。

※ llama.cppでは -np による並列スロット設計を行っていますが、vLLMでは実リクエストに応じてKV cacheが動的に消費されるため、同じ並列数を単純には比較していません。

Qwen3.5-122B NVFP4 用 docker-compose.yml を見る

services:

vllm-qwen35-122b:

image: nvcr.io/nvidia/vllm:26.03.post1-py3

container_name: vllm-qwen35-122b-nvfp4

platform: linux/arm64

restart: unless-stopped

ipc: host

shm_size: '32gb'

environment:

- TZ=Asia/Tokyo

- CUDA_VISIBLE_DEVICES=0

- NVIDIA_DISABLE_REQUIRE=true

- CUDA_MODULE_LOADING=LAZY

- VLLM_ALLOW_LONG_MAX_MODEL_LEN=1

- VLLM_TORCH_COMPILE_LEVEL=0

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: 1

capabilities: [gpu]

command:

- "vllm"

- "serve"

- "RedHatAI/Qwen3.5-122B-A10B-NVFP4"

- "--served-model-name"

- "qwen35-122b-nvfp4"

- "--host"

- "0.0.0.0"

- "--port"

- "8000"

- "--trust-remote-code"

- "--tokenizer"

- "Qwen/Qwen3.5-0.8B"

- "--dtype"

- "bfloat16"

- "--kv-cache-dtype"

- "fp8"

- "--max-model-len"

- "262144"

- "--max-num-batched-tokens"

- "16384"

- "--max-num-seqs"

- "4"

- "--enable-chunked-prefill"

- "--enable-prefix-caching"

- "--gpu-memory-utilization"

- "0.91"

- "--disable-custom-all-reduce"

- "--tokenizer-mode"

- "auto"

ports:

- "8000:8000"

volumes:

- ../cache:/root/.cache/huggingface

healthcheck:

test: ["CMD-SHELL", "curl -f http://localhost:8000/health || exit 1"]

interval: 30s

timeout: 30s

retries: 10

start_period: 1200s

※ Sehyo版は Sehyo/Qwen3.5-122B-A10B-NVFP4、txn545版は txn545/Qwen3.5-122B-A10B-NVFP4 に差し替え。

Nemotron3-120B NVFP4 用 docker-compose.yml を見る

services:

vllm-nemotron3-120b:

image: nvcr.io/nvidia/vllm:26.03.post1-py3

container_name: vllm-nemotron3-120b-nvfp4

platform: linux/arm64

restart: unless-stopped

ipc: host

shm_size: '32gb'

environment:

- TZ=Asia/Tokyo

- CUDA_VISIBLE_DEVICES=0

- NVIDIA_DISABLE_REQUIRE=true

- CUDA_MODULE_LOADING=LAZY

- VLLM_ALLOW_LONG_MAX_MODEL_LEN=1

- VLLM_TORCH_COMPILE_LEVEL=0

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: 1

capabilities: [gpu]

command:

- "vllm"

- "serve"

- "RedHatAI/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4"

- "--served-model-name"

- "nemotron3-120b-nvfp4"

- "--host"

- "0.0.0.0"

- "--port"

- "8000"

- "--trust-remote-code"

- "--chat-template"

- "{% for message in messages %}{{'<|im_start|>' + message['role'] + '\n' + message['content'] + '<|im_end|>\n'}}{% endfor %}{% if add_generation_prompt %}{{'<|im_start|>assistant\n'}}{% endif %}"

- "--dtype"

- "bfloat16"

- "--kv-cache-dtype"

- "fp8"

- "--max-model-len"

- "1048576"

- "--max-num-batched-tokens"

- "16384"

- "--max-num-seqs"

- "1"

- "--enable-chunked-prefill"

- "--enable-prefix-caching"

- "--gpu-memory-utilization"

- "0.91"

- "--disable-custom-all-reduce"

- "--tokenizer-mode"

- "auto"

ports:

- "8000:8000"

volumes:

- ../cache:/root/.cache/huggingface

healthcheck:

test: ["CMD-SHELL", "curl -f http://localhost:8000/health || exit 1"]

interval: 30s

timeout: 30s

retries: 10

start_period: 1200s

※ Unsloth版は unsloth/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4 に差し替え。

以下は、既存のllama.cpp / MXFP4構成における再現レシピです。vLLM / NVFP4構成とは推論エンジン、モデル形式、並列処理の考え方が異なるため、両者は単純な上位・下位関係ではなく、用途に応じて使い分ける前提で整理しています。

⚠️ 技術的留意事項とリスクについて

プロジェクト・ディレクトリ構造

PROJECT_ROOT/

├── build/

│ └── llama/

│ └── Dockerfile # Blackwell/Grace向けネイティブ・ビルド定義

├── docker/

│ ├── docker-compose.llama-gpt-oss-swallow-120b_standalone.yml # Swallow-120B 単体起動定義

│ ├── docker-compose.llama-qwen35-122b_standalone.yml # Qwen-3.5-122B 単体起動定義

│ └── docker-compose.llama-nemotron3-super-120b_standalone.yml # Nemotron-3-120B 単体起動定義

└── models/

├── GPT-OSS-Swallow-120B-RL-v0.1-MXFP4/ # Swallow GGUFモデル格納ディレクトリ

├── Qwen3.5-122B-A10B-MXFP4/ # Qwen GGUFモデル格納ディレクトリ

└── Nemotron-3-Super-120B-A12B-MXFP4/ # Nemotron GGUFモデル格納ディレクトリ

Dockerfile 構成

※ 本Docker構成はGPU・CUDAバージョンに依存するため、そのままでは動作しないケースがあります。

クリックして推論エンジンのビルド定義を展開(Dockerfile)

FROM nvidia/cuda:13.1.1-devel-ubuntu24.04

RUN apt-get update && apt-get install -y git build-essential cmake libcurl4-openssl-dev curl

RUN git clone https://github.com/ggml-org/llama.cpp.git

WORKDIR /llama.cpp

ENV LDFLAGS="-Wl,--allow-shlib-undefined"

# Blackwell (SM 12.1) ネイティブ・ビルドを指定

RUN cmake -B build \

-DGGML_CUDA=ON \

-DCMAKE_CUDA_ARCHITECTURES=121 \

-DLLAMA_BUILD_TESTS=OFF \

-DCMAKE_EXE_LINKER_FLAGS="-Wl,--allow-shlib-undefined" \

-DCMAKE_SHARED_LINKER_FLAGS="-Wl,--allow-shlib-undefined" && \

cmake --build build --config Release --target llama-server -j$(nproc)

RUN cp /llama.cpp/build/bin/llama-server /usr/local/bin/

ENTRYPOINT ["llama-server"]

Docker Compose による運用設計 Swallow-120B

クリックしてコードを展開(Swallow-120B 単体起動定義ファイル 完全版)

services:

llama-server:

build:

context: ../build/llama

dockerfile: Dockerfile

container_name: llama-gpt-oss-swallow-120b

platform: linux/arm64

restart: unless-stopped

ipc: host

shm_size: '16gb'

environment:

- TZ=Asia/Tokyo

- CUDA_VISIBLE_DEVICES=0

- NVIDIA_DISABLE_REQUIRE=true

- CUDA_MODULE_LOADING=LAZY

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: 1

capabilities: [gpu]

command:

- "-m"

- "/models/GPT-OSS-Swallow-120B-RL-v0.1-MXFP4/GPT-OSS-Swallow-120B-RL-v0.1-MXFP4_MOE-00001-of-00006.gguf"

- "--no-mmap" # モデル全量をVRAMに固定

- "--mlock" # OSによるメモリのスワップを防止(フリーズ対策)

- "-a"

- "gpt-oss-swallow-120b"

- "--host"

- "0.0.0.0"

- "--port"

- "8000"

- "-ngl"

- "99" # 全レイヤーをGPUへオフロード

- "-c"

- "1310720" # 総トークン数 (32,768 * 40スロット)

- "-np"

- "40" # 並列スロット数

- "-t"

- "18"

- "-tb"

- "20"

- "-fa"

- "on"

- "--numa"

- "distribute" # Grace-Blackwellのメモリアーキテクチャに適合

- "--ubatch-size"

- "1024"

- "-b"

- "1024"

- "--cont-batching"

- "--cache-type-k"

- "f16" # 精度優先でFP16を選択

- "--cache-type-v"

- "f16" # 精度優先でFP16を選択

- "--min-p"

- "0.05"

ports:

- "8000:8000"

volumes:

- ../models:/models

healthcheck:

test: ["CMD-SHELL", "curl -f http://localhost:8000/health || exit 1"]

interval: 30s

timeout: 10s

retries: 10

start_period: 1200s

Qwen35-122B

クリックしてコードを展開(Qwen35-122B 単体起動定義ファイル 完全版)

services:

llama-server:

build:

context: ../build/llama

dockerfile: Dockerfile

container_name: llama-qwen35-122b

platform: linux/arm64

restart: unless-stopped

ipc: host

shm_size: '16gb'

environment:

- TZ=Asia/Tokyo

- CUDA_VISIBLE_DEVICES=0

- NVIDIA_DISABLE_REQUIRE=true

- CUDA_MODULE_LOADING=LAZY

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: 1

capabilities: [gpu]

command:

- "-m"

- "/models/Qwen3.5-122B-A10B-MXFP4/Qwen3.5-122B-A10B-MXFP4_MOE-00001-of-00003.gguf"

- "--no-mmap" # モデル全量をVRAMに固定

- "--mlock" # OSによるメモリのスワップを防止(フリーズ対策)

- "-a"

- "qwen3.5-122b"

- "--host"

- "0.0.0.0"

- "--port"

- "8000"

- "-ngl"

- "99" # 全レイヤーをGPUへオフロード

- "-c"

- "1572864" # 総トークン数 (262,144 * 6スロット)

- "-np"

- "6" # 並列スロット数

- "-t"

- "18"

- "-tb"

- "20"

- "-fa"

- "on"

- "--numa"

- "distribute" # Grace-Blackwellのメモリアーキテクチャに適合

- "--ubatch-size"

- "1024"

- "-b"

- "1024"

- "--cont-batching"

- "--cache-type-k"

- "f16" # 精度優先でFP16を選択

- "--cache-type-v"

- "f16" # 精度優先でFP16を選択

- "--min-p"

- "0.05"

ports:

- "8000:8000"

volumes:

- ../models:/models

healthcheck:

test: ["CMD-SHELL", "curl -f http://localhost:8000/health || exit 1"]

interval: 30s

timeout: 10s

retries: 10

start_period: 1200s

Nemotron3-120B

クリックしてコードを展開(Nemotron3-120B 単体起動定義ファイル 完全版)

services:

llama-server:

build:

context: ../build/llama

dockerfile: Dockerfile

container_name: llama-nemotron3-super-120b

platform: linux/arm64

restart: unless-stopped

ipc: host

shm_size: '16gb'

environment:

- TZ=Asia/Tokyo

- CUDA_VISIBLE_DEVICES=0

- NVIDIA_DISABLE_REQUIRE=true

- CUDA_MODULE_LOADING=LAZY

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: 1

capabilities: [gpu]

command:

- "-m"

- "/models/Nemotron-3-Super-120B-A12B-MXFP4/NVIDIA-Nemotron-3-Super-120B-A12B-MXFP4_MOE-00001-of-00003.gguf"

- "--no-mmap" # モデル全量をVRAMに固定

- "--mlock" # OSによるメモリのスワップを防止(フリーズ対策)

- "-a"

- "nemotron3-super-120b"

- "--host"

- "0.0.0.0"

- "--port"

- "8000"

- "-ngl"

- "99" # 全レイヤーをGPUへオフロード

- "-c"

- "4194304" # 総トークン数 (1,048,576 * 4スロット)

- "-np"

- "4" # 並列スロット数

- "-t"

- "18"

- "-tb"

- "20"

- "-fa"

- "on"

- "--numa"

- "distribute" # Grace-Blackwellのメモリアーキテクチャに適合

- "--ubatch-size"

- "1024"

- "-b"

- "1024"

- "--cont-batching"

- "--cache-type-k"

- "q8_0" # 1Mトークンの作業メモリ確保のためQ8量子化を選択

- "--cache-type-v"

- "q8_0" # 1Mトークンの作業メモリ確保のためQ8量子化を選択

- "--min-p"

- "0.05"

ports:

- "8000:8000"

volumes:

- ../models:/models

healthcheck:

test: ["CMD-SHELL", "curl -f http://localhost:8000/health || exit 1"]

interval: 30s

timeout: 10s

retries: 10

start_period: 1200s

両構成(llama.cpp / vLLM)の設計思想を踏まえ、次章では実際の長文入力に対する推論性能を比較します。本検証では、約1.8万文字(約8,000〜13,000トークン)の実データ(実運用で扱う未加工テキスト)を用い、Prefill速度・Generate速度・処理時間を指標として、MXFP4(llama.cpp)とNVFP4(vLLM)の挙動差を整理します。

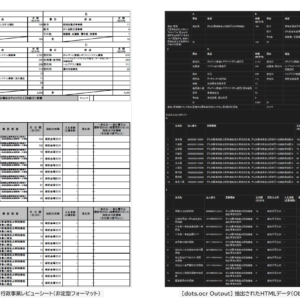

【第7章】長文入力における実測比較:MXFP4 / NVFP4

約1.8万文字の未加工テキストを入力し、長文処理時のPrefill速度とGenerate速度を確認しました。本節の数値は、絶対性能の優劣を示すものではなく、推論エンジン・モデル形式・コンテキスト設計の違いによる挙動差を把握するための参考値です。

本検証では、推論エンジン差に焦点を当てるため、比較の公正性を担保する目的で、NVFP4モデルについてはすべてRedHatAI提供のモデルに統一しています。なお一部モデルではトークナイザー設定の差異により追加調整が必要となる場合があり、本検証でも個別対応を行っています。推論エンジンごとの特性差を明確にするため、同一ハードウェア環境・同一データ条件で比較しています。

※ vLLMのGenerate速度は、ウォームアップおよび終端処理の影響を受けるため、本表では安定出力区間の値を代表値として採用しています。

※ 本記事では、安定性重視のllama.cpp構成と、並列処理に優れるvLLM構成を用途別に併記しています。

推論構成

モデル

Context

並列設定

Prefill

Generate

用途特性

llama.cpp(MXFP4)

Swallow-120B

32k

-np 40

1,976 tok/s

46.4 tok/s

即時応答・低遅延

Qwen3.5-122B

256k

-np 6

926 tok/s

21.8 tok/s

長文と速度のバランス

Nemotron3-120B

1M

-np 4

645 tok/s

16.4 tok/s

超長文処理

vLLM(NVFP4)

Qwen3.5-122B

256k

max-num-seqs 4

855 tok/s

13.4 tok/s

API運用・並列処理 *1)

Nemotron3-120B

1M

max-num-seqs 1

1,259 tok/s

11.0 tok/s

長文処理・出力要確認 *2)

※ MXFP4とNVFP4では、推論エンジン、モデル形式、KV cache設計、並列処理方式が異なるため、数値は単純な優劣ではなく、用途別の挙動差を把握するための参考値です。※ NVIDIA純正のNVFP4モデル については、本検証環境では動作確認ができなかったため、比較対象には含めていません。配布元やビルド条件により挙動が異なる可能性があります。※ 単一リクエスト時のGPU KV cache使用率は1%未満であり、並列度拡張の余地が確認されています。*1)※ vLLM / NVFP4のNemotron3では、今回の検証条件で冒頭に </think> が残存しました(内部思考制御の挙動差)。*2)

【結び】思考の深度を支える、新たな「土台」 NVIDIA Blackwell (GB10)を搭載したDGX Spark 互換機という強力な環境を、緻密な設計とプロンプトで運用した先に待っていたのは、単なる「処理時間の短縮」以上の変化でした。

それは、1時間強に及ぶ重厚な議論を数分で整理し、中小企業診断士やデータデザイナーとしての視点を補足してくれる。あたかも、複雑な情報の霧を晴らし、より本質的な検討に集中させてくれる「実戦的な伴侶」を得たような感覚 です。

これまで、ローカルLLM運用におけるモデルサイズの選択は、常に速度やリソースとの「折り合い」をどこでつけるかの戦いでした。今回、120B級の知能をローカルで自在に扱えるようになったことで、「情報の切り捨て」という妥協を最小限に抑え、より深く、精緻な対話へと踏み込むことが可能になりました。 これは、実務における解析の精度と信頼を積み上げていく上で、極めて重要なマイルストーンです。

インフラを設計し、リソースを逆算して環境を整える。この一連のプロセスは、単なる技術的な作業ではありません。変化の激しいAI時代において、思考の解像度を維持し続けるための、「良質な思考の土台作り」という不可欠な準備 であると、私は考えています。

本記事のレシピが、最新の知能を自身の「思考のパーツ」として取り込もうとする皆さまにとって、一つの確かな足がかりになれば幸いです。

【謝辞:Acknowledgements】

本検証における120B級モデルの運用は、GGUF MXFP4量子化モデルおよびNVFP4モデルを公開してくださったコミュニティの多大な貢献により実現しました。

Swallow-120B 量子化:mmnga-o 氏

Qwen35-122B / Nemotron3-120B 量子化:Unsloth チーム

また、NVFP4モデルの公開・配布に関しては、以下のリポジトリを参照しています。

個人・組織を問わず、最先端の知能をローカルで扱える形で提供し続けてくださるコミュニティの皆さまに、心より敬意と感謝の意を表します。

関連記事

2025.12.26

NVIDIAの次世代アーキテクチャ Grace-Blackwell (GB10) を搭載したマシンにおいて、推論エンジン (vLLM) と 音声文字起こし (Whisper) を同一GPU内(VRAM 128GB)で安定稼働させるための...

2025.02.20

〜RAG対応スマートAIアシスタントの作り方〜

本記事では、プライベートなLLM環境をAWS EC2上に構築する方法について、初心者の方にも分かりやすく解説していきます。

はじめに

プライベートLLM環境の特徴

...

2026.03.07

本サイトではこれまで、「クラウド環境でのプライベートLLM構築(AWS EC2 × Ollama)」、そして「ハイエンド・ローカル環境での音声文字起こし(NVIDIA Blackwell × Whisper)」と、環境とモーダル(入力形式)を...